A rápida adoção de frameworks de inteligência artificial trouxe ganhos significativos de produtividade, mas também abriu novas superfícies de ataque. Um exemplo recente envolve o Chainlit, uma estrutura popular para criação de aplicações baseadas em LLMs (Large Language Models), que apresentou falhas de segurança críticas capazes de permitir o roubo de dados sensíveis.

As vulnerabilidades exploram bugs de leitura arbitrária de arquivos e falhas do tipo SSRF (Server-Side Request Forgery), possibilitando que atacantes acessem recursos internos, arquivos confidenciais e até serviços protegidos.

- Leia Também: Data centers de IA vão consumir 70% dos chips de memória

- Leia Também: Resumo semanal: explorações da fortinet, clipjack da redLine, quebra de NTLM, ataque ao copilot e mais

- Leia Também: Fraudes com imagens no Gov.br mostram por que biometria sozinha não basta

O que é o Chainlit e por que ele é tão utilizado

O Chainlit é um framework open source amplamente usado para:

- Criar interfaces conversacionais com LLMs

- Desenvolver aplicações de IA rapidamente

- Integrar modelos com APIs, bancos de dados e arquivos

- Construir chatbots, assistentes e ferramentas internas

Sua popularidade se deve à facilidade de uso, integração com ecossistemas de IA modernos e rapidez no desenvolvimento.

No entanto, essa mesma flexibilidade pode se tornar um problema quando controles de segurança não são bem implementados.

Clique aqui e teste por 30 dias grátis nossos serviços

Entendendo as falhas de leitura arbitrária de arquivos

Uma das vulnerabilidades identificadas permite que um atacante leia arquivos arbitrários no servidor, algo extremamente perigoso.

Como isso acontece

- Entradas do usuário não são devidamente validadas

- Caminhos de arquivos podem ser manipulados

- O sistema acaba acessando arquivos fora do escopo permitido

Isso pode permitir acesso a:

- Variáveis de ambiente

- Chaves de API

- Tokens de autenticação

- Arquivos de configuração

- Dados internos da aplicação

Em aplicações de IA, estes arquivos costumam conter informações altamente sensíveis.

SSRF: quando o servidor ataca a si mesmo

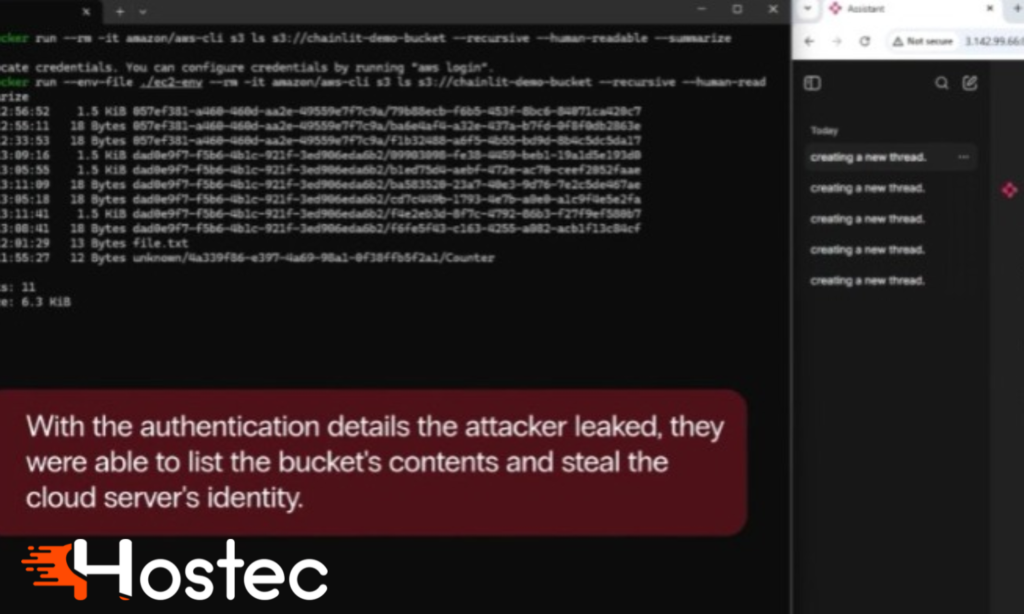

A segunda falha crítica envolve SSRF (Server-Side Request Forgery), uma técnica em que o atacante faz o servidor realizar requisições HTTP em seu nome.

Riscos do SSRF

- Acesso a serviços internos

- Consulta a endpoints administrativos

- Exploração de metadados de cloud

- Comunicação com serviços que não deveriam ser públicos

Em ambientes de nuvem, SSRF pode levar ao comprometimento completo da infraestrutura.

Por que falhas em aplicações de IA são ainda mais críticas

Aplicações baseadas em IA normalmente possuem:

- Acesso a grandes volumes de dados

- Integrações com múltiplos serviços

- Tokens privilegiados

- Ambientes altamente dinâmicos

Quando vulnerabilidades como SSRF e leitura de arquivos estão presentes, o impacto é amplificado, pois o atacante pode correlacionar dados, extrair contexto e escalar privilégios.

Cenários reais de exploração

Em um ataque bem-sucedido, um invasor pode:

- Explorar a leitura de arquivos para obter chaves de API

- Usar SSRF para acessar serviços internos

- Consultar metadados de cloud

- Assumir controle de recursos adicionais

- Exfiltrar dados sensíveis em larga escala

Tudo isso sem precisar de autenticação avançada.

Ambientes mais afetados

Essas falhas são especialmente perigosas em:

- Aplicações de IA expostas à internet

- Ferramentas internas mal isoladas

- Ambientes cloud mal configurados

- Sistemas que processam arquivos enviados por usuários

- APIs de IA sem validação robusta de entrada

Startups e empresas em rápido crescimento costumam ser as mais vulneráveis.

Riscos para empresas e usuários

As consequências podem incluir:

- Vazamento de dados confidenciais

- Exposição de prompts e lógica interna

- Roubo de propriedade intelectual

- Quebra de conformidade (LGPD, GDPR)

- Danos à reputação

- Perdas financeiras

Em ambientes corporativos, um incidente desse tipo pode se transformar rapidamente em uma crise de segurança.

Como mitigar falhas de leitura de arquivos e SSRF

1. Validação rigorosa de entradas

Nunca confie em dados fornecidos pelo usuário, especialmente caminhos de arquivos e URLs.

2. Restrição de acesso a arquivos

Implemente listas de permissão (allowlists) e isolamento de diretórios.

3. Proteção contra SSRF

- Bloqueie requisições para IPs internos

- Restrinja acesso a metadados de cloud

- Valide e sanitize URLs

4. Princípio do menor privilégio

Tokens e credenciais devem ter permissões mínimas.

5. Monitoramento contínuo

Detecte acessos anômalos e requisições suspeitas em tempo real.

O papel da infraestrutura na segurança de aplicações de IA

Uma infraestrutura mal configurada potencializa falhas de aplicação. Já um ambiente bem estruturado oferece:

- Isolamento entre serviços

- Firewalls e regras de rede

- Monitoramento e logs centralizados

- Resposta mais rápida a incidentes

A base da segurança começa fora do código.

Boas práticas de segurança para frameworks de IA

- Revisões de código frequentes

- Testes de segurança automatizados

- Auditorias independentes

- Atualizações constantes de dependências

- Separação entre ambientes (dev, staging, prod)

- Documentação clara de riscos

Essas práticas ajudam a reduzir falhas antes que sejam exploradas.

As falhas identificadas na estrutura de IA Chainlit mostram que a segurança precisa acompanhar a velocidade da inovação em IA. Bugs de leitura de arquivos e SSRF são vulnerabilidades conhecidas, mas continuam causando grandes impactos quando aplicadas a sistemas modernos e altamente integrados.

Empresas que desenvolvem ou utilizam aplicações de IA precisam tratar segurança como parte essencial do design, não como um complemento posterior.

Investir em boas práticas, validação rigorosa e infraestrutura confiável é o caminho para explorar o potencial da IA sem expor dados e negócios a riscos desnecessários.

Clique aqui e teste por 30 dias grátis nossos serviços